瑞芯微 RK182X 重磅更新|RKNN3 SDK V1.0.0上線,多模態(tài)模型全覆蓋!

2026-03-09

瑞芯微 RK1820/RK1828 AI 協(xié)處理器 RKNN3 SDK V1.0.0 正式版發(fā)布, 完美適配 RK3588/RK3576+RK1820/RK1828 硬件組合,為端側(cè) AI 模型部署提供全棧式軟件支撐,在性能、模型適配、功能、精度上全方位升級(jí),兼具高性能、高適配、高能耗比優(yōu)勢(shì)。

本次 SDK 覆蓋 PC 端開(kāi)發(fā)套件、板端運(yùn)行 API、模型轉(zhuǎn)換部署示例,支持 Android/Linux 系統(tǒng),PCIe/USB 高速接口實(shí)現(xiàn)低延遲數(shù)據(jù)交互;核心功能優(yōu)化亮點(diǎn)突出:

1. 推理效率升級(jí):支持?jǐn)?shù)據(jù)傳輸與推理并行,優(yōu)化核心算子,多核多模型同時(shí)推理適配高并發(fā);

2. 大模型適配更強(qiáng):支持 mRoPE、Function Call,兼容主流大模型特性;

3. 開(kāi)發(fā)部署更便捷:支持連板精度分析,提供 Python API 輕量化工具包,協(xié)處理器可自定義模型后處理,rkllm3 server 新增 embedding 模型支持。

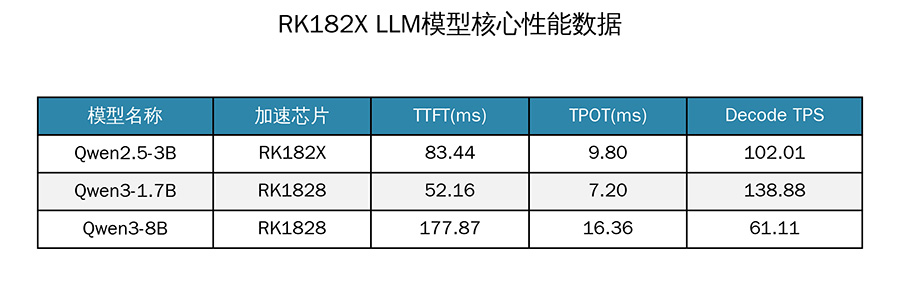

核心性能躍升!LLM 解碼效率提升超 15%,3B 破百且最高支持 8B

本次 SDK 正式版的核心突破之一,便是LLM Decode 性能整體提升超過(guò) 15%,針對(duì) 0.5B-8B 不同參數(shù)量級(jí) LLM 模型完成深度適配優(yōu)化,RK1820/RK1828 根據(jù)算力特性做差異化適配,可滿(mǎn)足不同端側(cè)場(chǎng)景的 LLM 推理需求。

測(cè)試數(shù)據(jù)顯示,RK182X 在輕量型 LLM 模型上的性能表現(xiàn)尤為亮眼,3B 量級(jí)模型實(shí)現(xiàn)了 Decode TPS 破百的關(guān)鍵突破,Qwen2.5-3B 模型 Decode TPS 達(dá) 102.01,為端側(cè)實(shí)時(shí)大模型交互提供了高效支撐;極致輕量的 Qwen2.5-0.5B 模型同樣表現(xiàn)出色,TTFT 僅 21.89ms、TPOT 4.63ms、Decode TPS 215.86;中大型 LLM 模型方面,Qwen3-8B 在 RK1828 上實(shí)現(xiàn)穩(wěn)定推理,Decode TPS 達(dá) 61.11,可充分滿(mǎn)足端側(cè)中大型 LLM 的部署需求。

*不同參數(shù)量 LLM 模型在 RK182X 上的核心性能數(shù)據(jù)如下:

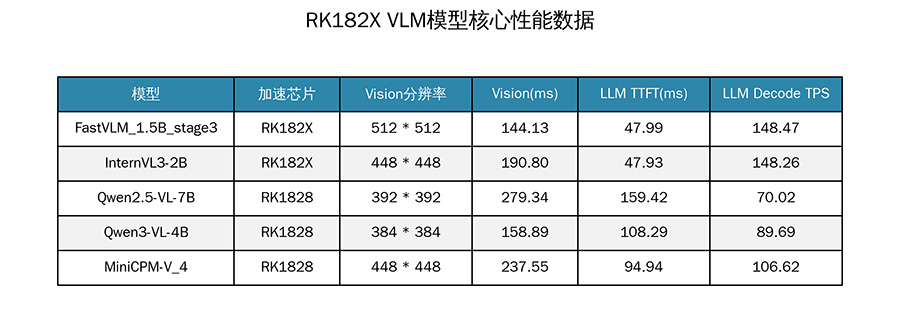

VLM 模型性能:多模態(tài)推理高效穩(wěn)定

在相同標(biāo)準(zhǔn)測(cè)試環(huán)境下,RK182X 對(duì)多款主流 VLM 及全模態(tài)模型完成深度推理優(yōu)化,RK1820/RK1828 根據(jù)算力特性實(shí)現(xiàn)差異化適配,不同視覺(jué)分辨率下均保持穩(wěn)定的視覺(jué)推理耗時(shí),且 LLM 解碼端性能高效,其中完美支持 Qwen3-VL 系列模型,Qwen3-VL-4B 的 LLM Decode TPS 接近 90TPS,RK1828 更實(shí)現(xiàn)中大型 VLM 模型全協(xié)處理器端推理,多模態(tài)交互性能表現(xiàn)優(yōu)異。

*不同 VLM 模型在 RK182X 上的核心性能數(shù)據(jù)如下:

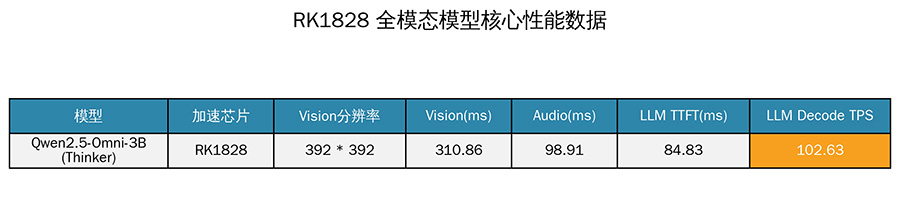

RK1828 完美適配 Qwen2.5-Omni-3B 全模態(tài)模型,實(shí)現(xiàn)音視覺(jué) + 語(yǔ)言全鏈路高效推理,解碼 TPS 達(dá) 102.63 成功破百;全協(xié)處理器端獨(dú)立完成推理,392*392 視覺(jué)分辨率下推理耗時(shí)穩(wěn)定,音頻推理僅 98.91ms,多模態(tài)處理效率優(yōu)異。

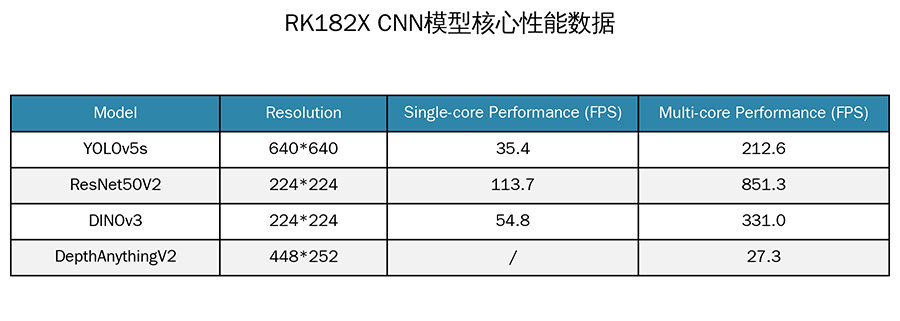

RK182X 針對(duì)經(jīng)典分類(lèi)、檢測(cè)類(lèi) CNN 模型完成單核及多 batch 多核推理深度優(yōu)化,依托多核多模型同時(shí)推理的特性充分釋放算力,DINOv3 的 ViT 性能表現(xiàn)尤為突出;在保持單核算力穩(wěn)定的基礎(chǔ)上,多batch 多核模式下幀率實(shí)現(xiàn)數(shù)倍提升,高吞吐特性可高效適配智能監(jiān)控、工業(yè)檢測(cè)等高并發(fā)計(jì)算機(jī)視覺(jué)應(yīng)用場(chǎng)景,性能與能耗比兼具。

* 不同 CNN 模型在RK182X 上的核心性能數(shù)據(jù)如下:

精度近乎無(wú)損!量化優(yōu)化做到 “性能升級(jí),精度不丟”

RKNN3 SDK V1.0.0 針對(duì)不同類(lèi)型模型采用差異化量化策略,其中 LLM/VLM 模型采用 W4A16 G32 量化策略,CNN 模型采用 W8A8 量化策略。在大幅提升推理性能的同時(shí),量化后模型精度與原始 float32 版本基本持平,部分模型精度實(shí)現(xiàn)反超,有效控制精度損失,真正做到性能升級(jí)、效果不減。

全鏈路模型生態(tài)布局 夯實(shí) AIoT2.0感知 - 決策 - 執(zhí)行能力

RKNN3 SDK V1.0.0 緊扣 AIoT2.0感知 - 決策 - 執(zhí)行的核心架構(gòu),完成超 30 款主流 AI 模型全維度適配,深度聯(lián)動(dòng)上下游核心合作伙伴,打通硬件算力、軟件棧與算法模型的生態(tài)壁壘,模型支持完整、適配效果好,充分釋放 RK182X 協(xié)處理器的算力價(jià)值。

在感知層:多模態(tài)數(shù)據(jù)采集能力拉滿(mǎn),頭部伙伴模型深度適配。打造端側(cè)多模態(tài)智能數(shù)據(jù)入口,視覺(jué)端全面適配 Mobilenet、YOLO 系列等經(jīng)典 CNN 視覺(jué)模型及深度估計(jì)模型;音頻端深度聯(lián)動(dòng)科大訊飛、思必馳、大象聲科等感知層頭部伙伴,完成 ASR、TTS 等核心語(yǔ)音模型適配,多模態(tài)感知能力高效落地。

在決策層:全規(guī)格模型生態(tài)閉環(huán),頭部廠商核心模型逐一適配。適配 Qwen3-VL、GLM Edge 等主流開(kāi)源大模型,全兼容 0.5B-8B全規(guī)格 LLM 模型,同時(shí)深度適配千問(wèn) Qwen2.5-Omni-3B、智譜 MiniCPM、階躍星辰 Step-GUI-Edge 等頭部廠商核心模型,全模態(tài)智能決策能力端側(cè)高效運(yùn)行。

在執(zhí)行層:軟硬協(xié)同賦能場(chǎng)景落地,適配全鏈路模型能力轉(zhuǎn)化。依托 RK3588/RK3576+RK182X 軟硬件組合,支持協(xié)處理器自定義模型后處理,可靈活適配各類(lèi)模型決策結(jié)果執(zhí)行邏輯;兼容 Android/Linux 系統(tǒng),讓全品類(lèi) AI 能力無(wú)縫落地到智能硬件、工業(yè)檢測(cè)等多元場(chǎng)景,實(shí)現(xiàn)從算法到應(yīng)用的完整轉(zhuǎn)化。

此外,SDK 全面兼容 Hugging Face、ModelScope、GitHub 等開(kāi)源平臺(tái),用戶(hù)可直接從Github獲取預(yù)先轉(zhuǎn)好的 RKNN 模型:

• Model Zoo地址:https://github.com/airockchip/rknn3-model-zoo;

• 工具提取地址:https://github.com/airockchip/rknn3-toolkit;

RK1820/RK1828 RKNN3 SDK V1.0.0 正式版的發(fā)布,是瑞芯微在端側(cè) AI 協(xié)處理器領(lǐng)域的重要突破,從性能躍升、模型擴(kuò)展到精度優(yōu)化,每一項(xiàng)更新均緊扣開(kāi)發(fā)者實(shí)際部署需求,讓 RK182X 的高算力、高能耗比優(yōu)勢(shì)充分釋放。未來(lái),瑞芯微將持續(xù)迭代優(yōu)化 RKNN3 SDK,不斷擴(kuò)展模型支持范圍、提升算力表現(xiàn),打造更高效的端側(cè) AI 開(kāi)發(fā)工具鏈,助力更多 AI 創(chuàng)新應(yīng)用在端側(cè)落地。

瑞芯微市場(chǎng)部郵箱:rkmarketing@rock-chips.com,歡迎各來(lái)自五湖四海的AI 伙伴對(duì)接交流,攜手探索端側(cè) AI 多場(chǎng)景落地新可能。

上一篇: 德國(guó)嵌入式展 | 瑞芯微亮相embedded world 2026,端側(cè)AI引領(lǐng)工業(yè)智能化 下一篇:瑞芯微首屆AI軟件生態(tài)大會(huì):AI重塑千行百業(yè),務(wù)實(shí)探索合作路徑,共筑端側(cè)智能新生態(tài)

閩公網(wǎng)安備 35010202001061號(hào)

閩公網(wǎng)安備 35010202001061號(hào)